“국내 감시·자율무기 무인 사용 금지” 명문화

[메타X(MetaX)]Sam Altman OpenAI CEO가 미국 ‘전쟁부(Department of War)’와 자사 AI 모델을 기밀 네트워크에 배치하기로 합의했다고 밝혔다.

공식 명칭은 United States Department of Defense이지만, 올트먼은 상징적 의미를 담아 ‘전쟁부’라는 표현을 사용했다. 그는 계약에 안전 원칙을 명문화했으며, 기술적 가드레일과 클라우드 전용 배치를 병행하겠다고 강조했다.

![[메타X(MetaX)]Sam Altman, 美 ‘전쟁부’와 기밀망 배치 합의](https://metax.kr/news/data/2026/03/01/p1065572588948148_779_thum.png)

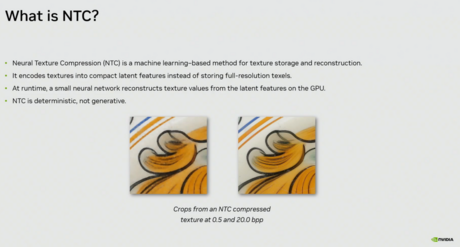

이번 합의의 핵심은 세 가지다.

첫째, OpenAI 모델을 미 국방 당국의 기밀 네트워크에 배치하되 국내 대규모 감시에는 활용하지 않는다는 점을 계약에 반영했다. 둘째, 자율무기 운용 시 ‘인간 책임(human responsibility for the use of force)’ 원칙을 명시해 최종 판단과 책임은 인간에게 있다는 점을 분명히 했다. 셋째, 모델 오작동 및 오남용 방지를 위한 기술적 안전장치를 구축하고, 배치는 온프레미스가 아닌 클라우드 네트워크에서만 이뤄진다고 밝혔다. 이는 중앙 통제와 실시간 패치, 필요 시 원격 차단 가능성을 유지하겠다는 구조다.

‘Department of War’라는 표현은 AI의 군사 활용이 더 이상 추상적 논의가 아니라 현실 정책 단계에 진입했음을 시사한다. 동시에 안전 원칙을 선제적으로 강조함으로써 내부 반발과 윤리 논쟁을 관리하려는 전략적 메시지로 해석된다. AI 산업은 과거 군사 계약을 둘러싸고 연구자·엔지니어의 공개 반발을 겪어왔다. 최근에도 Google와 OpenAI 직원 수백 명이 공개서한을 통해 정부의 과도한 요구 가능성에 우려를 표명한 바 있다.

쟁점은 크게 두 갈래다. 하나는 국내 대규모 감시 문제다. AI가 영상·음성·텍스트 데이터를 대규모로 분석해 시민 활동을 추적하는 데 활용될 경우, 미국 헌법상 사생활 보호 원칙과 충돌할 수 있다. 다른 하나는 완전 자율 살상 체계다. 유엔 차원에서도 자율무기 규제 논의가 이어지는 가운데, 인간 통제 원칙이 실제 작전 환경에서 어떻게 집행될지가 핵심 변수다.

산업적으로는 AI-국방 협력이 제도권 단계로 편입되는 신호로 읽힌다. AI는 정보 분석, 전략 시뮬레이션, 사이버 방어, 군수 물류 최적화 등 광범위한 영역에 적용 가능하다. OpenAI는 동일한 안전 조건을 타 AI 기업에도 적용하길 요구했다고 밝혀, 군사 계약의 최소 윤리 기준을 업계 전반에 표준화하려는 의도도 드러냈다.

다만 위험 요소도 남아 있다. 계약 세부 내용의 공개 범위, 감시 범위 정의의 모호성, 자율무기 통제의 실제 집행 가능성, 해외 작전 적용 범위 등이 논쟁 지점이다. 국방물자생산법(Defense Production Act) 등 정부 권한과 기업 자율성의 경계도 향후 법적·정치적 쟁점이 될 수 있다.

이번 합의는 AI 기업이 단순 기술 공급자를 넘어 정책 행위자로 이동했음을 보여준다. 민간 기업이 군사기관과 안전 원칙을 협상하고 이를 공개적으로 천명하는 구조는 과거 방산 계약과 다른 양상이다. AI는 더 이상 중립적 도구가 아니라 국가 안보, 산업 전략, 윤리가 교차하는 전략 인프라가 됐다.

OpenAI의 결정은 기술과 권력의 관계가 재정의되는 장면으로 기록될 가능성이 크다. AI 시대의 통제권이 어디에 놓일 것인지, 그리고 그 통제에 대한 책임을 누가 질 것인지에 대한 질문이 본격적으로 제기되고 있다.

[저작권자ⓒ META-X. 무단전재-재배포 금지]