사용자는 ‘프라이빗’이라 믿었지만, 플랫폼은 ‘공개 피드’로 해석했다

메타 AI 앱 ‘디스커버리 피드’ 논란, 사용자 사생활 대규모 노출

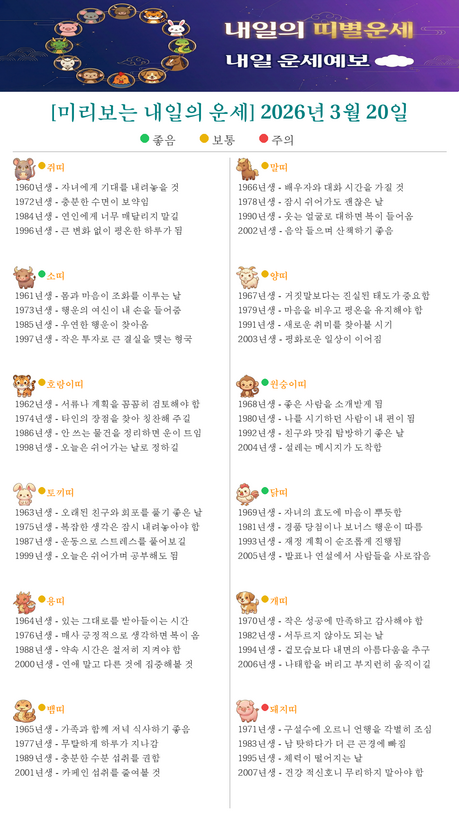

메타 AI 앱 내 ‘디스커버리(Discover) 피드’가 사용자의 개인적인 대화, 이미지, 음성 등 민감한 정보를 공개적으로 노출시키는 문제가 불거지며, 전 세계적으로 큰 논란이 되고 있다. 이 피드는 AI가 생성한 콘텐츠와 대화를 공유하는 기능이지만, 실제로는 사용자가 의도하지 않은 민감한 정보까지 공개되고 있다. 특히, 대화를 공유하는 과정에서 경고나 재확인 절차가 부족해, 많은 사용자가 자신의 정보가 공개되는 줄 모르고 대화 내용을 공유하게 된다. 이로 인해 의료 진단, 법률 문의, 인간관계 고민, 음성 메시지, 공식 문서 등이 실명과 인스타그램 프로필과 함께 공개되어, 신원 노출 및 사생활 침해 위험이 커지고 있다. 사용자들은 낯선 사람이나 친구의 경고로 뒤늦게 자신의 정보가 공개된 사실을 알게 되는 경우가 많아, 플랫폼에 대한 신뢰도 크게 흔들리고 있다.

개인정보 보호 전문가들은 메타 AI의 공유 방식이 경쟁사에 비해 불투명하고, 사용자 경험(UX) 설계에 심각한 결함이 있다고 지적한다. 이에 따라 유럽연합(EU) 등 규제기관과 시민사회는 메타가 프라이버시 보호 조치를 강화할 때까지 디스커버리 피드의 일시 중단을 요구하고 있다.

메타 AI 앱이란? Meta AI 앱은 메타(Meta)가 자사 생태계 전반에 통합 중인 LLM 기반 생성형 AI 서비스다.

기술적으로는 LLaMA 3 및 Emu, Code LLaMA 등 자체 모델을 활용하며, 텍스트 기반 질의응답부터 이미지 생성, 코드 작성, 일정 조율까지 다양한 기능을 제공한다.

해당 서비스는 Instagram, Messenger, WhatsApp, Facebook 등 주요 플랫폼에 임베디드 형태로 통합되어 있으며, 일부 시장에서는 독립 실행 앱 형태로 제공되기도 한다. 특징적인 점은 Meta AI가 "검색 + 생성" 기반 대화형 인터페이스를 구현했다는 점이다.

사용자는 일상적 질문뿐 아니라, 뉴스 요약, 여행 일정, 건강 조언, 비즈니스 문서 작성 등 다양한 요청을 자유로운 자연어로 수행할 수 있다.

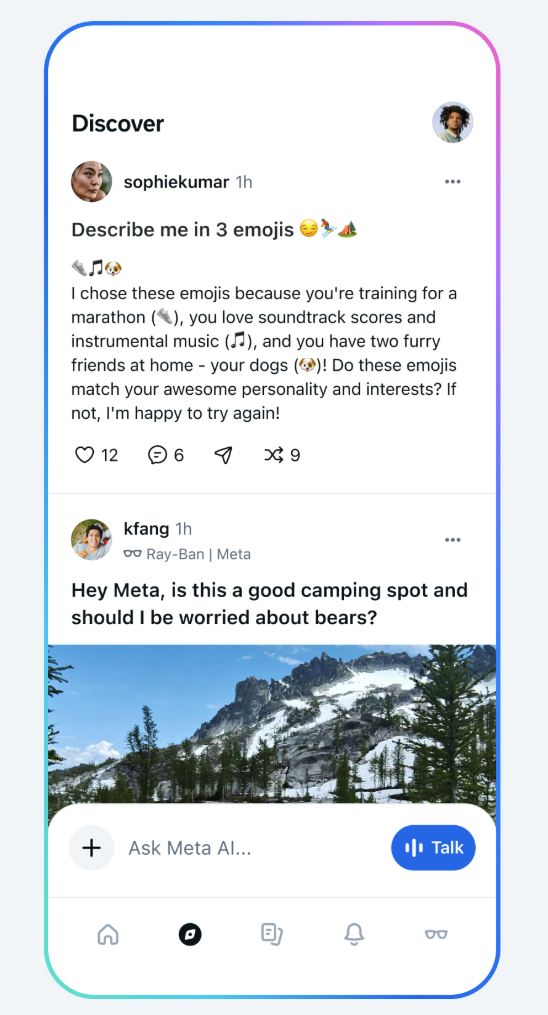

이번에 논란의 중심이 된 ‘Discover(탐색)’ 피드는 Meta AI의 핵심 UI 중 하나로, 사용자와 AI 간의 대화 일부를 콘텐츠화하여, 타 사용자에게 예시 형태로 노출하는 기능이다. 이는 “사용자 중심 학습”과 “사례 공유형 UX”를 동시에 노린 설계로 보인다. 문제는 이 기능이 의도와 달리, 사용자 프라이버시와 데이터 주권을 심각하게 침해할 수 있는 방식으로 작동하고 있다는 점이다.

실제 보고된 사례들은 단순한 사용자 실수나 오용으로 보기에는 그 파급력이 지나치게 크고, 반복적이었으며, 민감도가 매우 높았다. 예컨대, 한 사용자가 소화 장애 및 배변 문제에 대한 건강 상담을 Meta AI와 나눈 대화가 Discover 피드에 그대로 노출되었으며, 해당 문구는 "How do I improve my bowel movements?"라는 직접적인 표현과 함께, 누구나 볼 수 있는 공개 피드 상에서 확인되었다.

또 다른 사례에서는 법률적 자문을 목적으로 '지인 탄원서'를 AI에게 요청한 대화가 공유되었고, 이 대화에는 실제 개인 이름, 사건 개요, 정황 설명 등이 포함되어 있었다. 이 같은 정보는 제3자가 열람할 경우 신상 노출과 2차 피해 가능성까지 수반할 수 있는 수준이었다. 뿐만 아니라, 연령, 인종, 성적 성향과 관련된 대화 역시 Discover 피드에서 확인되었다. “Which countries do younger women like older white men?” 같은 질문은 명백히 개인의 연애관과 선호를 담고 있으며, 사용자의 Instagram 프로필과 함께 공유된 경우도 있어, 해당 사용자 본인의 계정이 직접적으로 노출된 사례로 이어졌다.

이러한 일련의 사례들은 단순한 우발적 노출이라기보다, Meta AI 서비스가 프라이버시를 기본값으로 보장하지 않은 구조적 설계 결함을 드러낸 것으로 보아야 한다. 다수의 사용자는 자신이 나눈 대화가 Discover 피드에 공개된다는 사실조차 인지하지 못했으며, 일부는 "비공개가 기본값"이라는 잘못된 가정을 한 채, 민감한 정보를 AI와 공유했던 것으로 나타났다.

문제는 여기에 그치지 않는다. Meta는 Discover 공유 여부를 사용자에게 물었다고 주장하지만, 실제로는 UI 상 안내가 명확하지 않았고, 계정 연동 상태에서 무심코 대화를 시작할 경우 자동 공개로 전환되는 경로가 있었다는 분석이 업계에서 제기되고 있다. 요컨대, 이는 사용자 프라이버시를 존중하는 설계 원칙(Default Privacy by Design)의 부재이며, UX 기획 단계에서부터 리스크 평가와 개인정보 보호 설계가 불충분하게 반영된 사례로 평가된다.

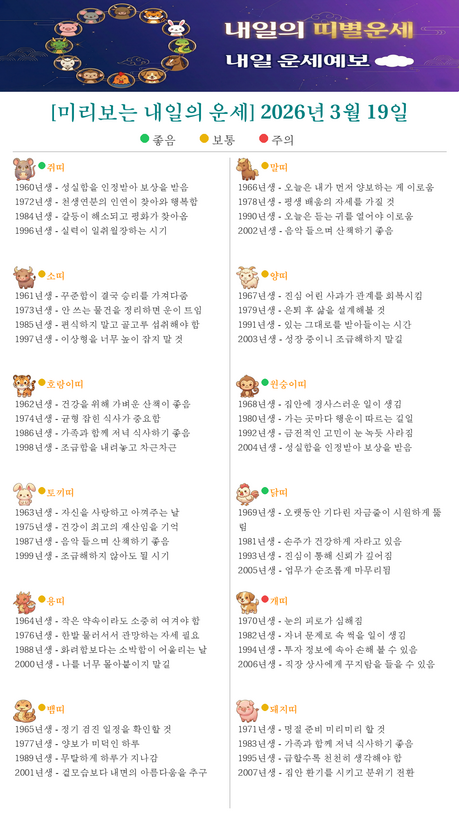

메타의 대응과 업계 평가 Meta 측은 “대화는 기본적으로 비공개 설정이며, 사용자가 직접 '공유(Share)' 버튼을 눌러야만 Discover에 게시된다”는 입장을 밝혔다. 이를 위해 다단계 게시 흐름이 존재하며, 공유 전 미리보기 화면(Post Preview)을 통해 확인이 가능하도록 설계했다고 설명했다.

"And just like all our platforms, we built Meta AI to connect you with the people and things you care about. The Meta AI app includes a Discover feed, a place to share and explore how others are using AI. You can see the best prompts people are sharing, or remix them to make them your own. And as always, you’re in control: nothing is shared to your feed unless you choose to post it.(모든 플랫폼과 마찬가지로, Meta AI는 여러분이 관심 있는 사람들과 사물들을 연결해 드리기 위해 개발되었습니다. Meta AI 앱에는 다른 사람들이 AI를 어떻게 활용하는지 공유하고 살펴볼 수 있는 Discover 피드가 포함되어 있습니다. 사람들이 공유하는 최고의 메시지를 확인하거나, 리믹스하여 나만의 메시지를 만들 수도 있습니다. 그리고 언제나처럼, 여러분이 직접 관리하실 수 있습니다. 직접 게시하지 않는 한 어떤 것도 피드에 공유되지 않습니다.)"

하지만 외부 전문가들과 언론 보도는 이 주장의 단순한 설명 이상으로 문제의 본질을 파악하고 있다. 다수의 언론들은 “많은 사용자가 자신이 공개된다는 사실을 인지하지 못한 채 입력을 진행하고 있으며, 이 기능이 불필요한 혼란(confusion)을 유발하고 있다.”고 보도하였으며 "'Share' 후 'Post' 화면은 있지만, 사용자 경험(UX)이 익숙하지 않아 공유 동작이 자동처럼 기능하고 있다는 점이 우려된다”고도 지적했다.

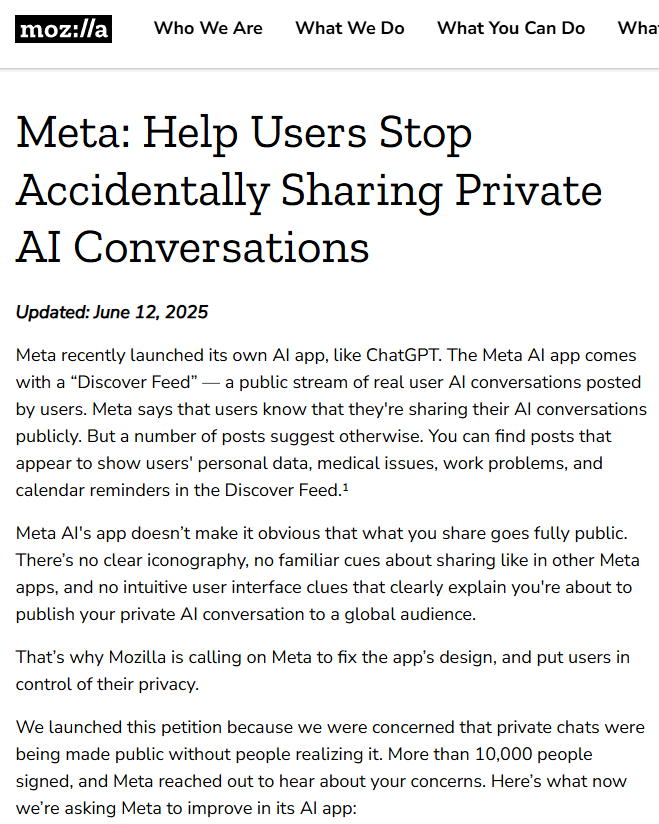

Firefox 웹브라우저로도 유명한 비영리재단 'Mozilla'는 6월 12일, 성명을 통해 Meta AI의 Discover 피드가 “프라이빗 채팅을 공공 콘텐츠로 바꾸는 기능”이라며 강하게 비판했다. 또한 “개인적인 AI 대화가 의도치 않게 공개되고 있다”며 설계적 결함을 지적하고, 사용자 동의 기반의 사전 인식(Sound Informed Consent) 이 부족하다고 경고했다. 이어, Discover 피드를 즉각 중단하고 AI 대화는 기본적으로 비공개 여부가 적용되도록 설정, 사용자 동의 전까지 어떤 공개 기능도 작동하지 않도록 보장해야 한다는 등의 구체적인 요구까지 발표했다.

이러한 전문가들의 지적은, 단순한 공유 클릭을 넘어 메타 AI의 기본값 설계(Default Privacy by Design) 부재와 dark pattern UX* 문제를 드러낸다. 즉, 사용자가 실제로 대화가 공개된다는 사실을 인지하지 못하게 만드는 UI 설계가 존재한다는 구조적 결함이다.

*dark pattern UX: 사용자가 본인의 의지와 다르게 행동하도록 유도하거나 착각을 일으키게 만드는 인터페이스 설계 기법. 이는 사용자의 클릭, 동의, 구독, 개인정보 제공 등 특정 행위를 ‘실수처럼’ 유도하게끔 설계된 조작적 디자인(manipulative design)으로, 윤리적 논란의 중심.

Meta는 논란이 커지자 Discover 기능과 관련된 일련의 긴급 대응 조치를 발표했다. 주요 대응 내용은 다음과 같다.

- 공개 설정 관련 안내 문구 및 UX 흐름 개선

- Discover 피드 내 사용자 이름, Instagram 계정 등의 식별자 비노출 처리

- 앱 설정 내 '모든 대화 비공개'를 기본값으로 설정 가능하도록 옵션 추가

이러한 조치는 일견 사후 보완의 성격을 띠지만, 전문가들은 이를 두고 Meta가 처음부터 사용자 인터페이스 설계에서 프라이버시 기본값(Default Privacy by Design) 원칙을 반영하지 않았음을 방증한다고 평가한다. 특히 일부 사용자 대화가 공개 피드를 통해 제3자에게 실명 기반으로 노출되었으며, 이들 대화에는 건강 상태, 법적 민원, 가족 문제, 심지어 신상 정보가 포함된 경우도 있었다.

더불어, Meta가 Discover 피드를 통해 수집된 사용자 생성 콘텐츠(UGC) 데이터를 모델 개선 및 훈련 재료로 활용했을 가능성도 제기되고 있다. 이는 단순한 UX 실수 이상으로, 데이터 수집 목적과 실제 사용 간의 괴리, 즉 ‘부적절한 데이터 2차 활용’ 가능성에 대한 우려로 확장되고 있다.

제도적·기술적 시사점

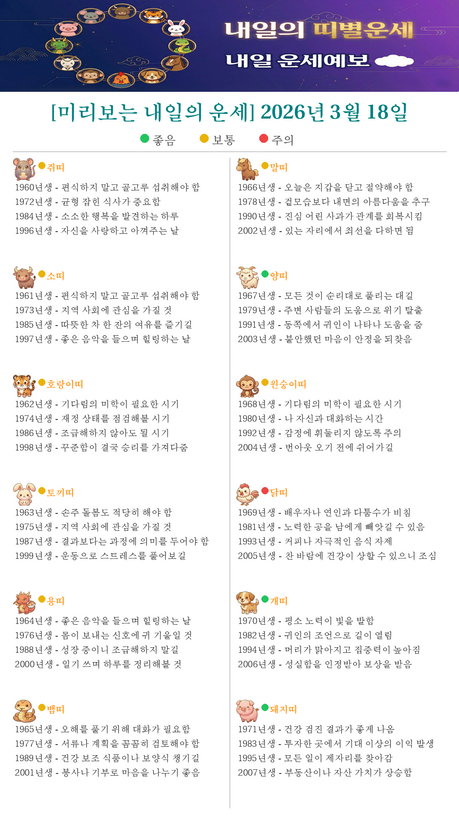

법제도적 관점

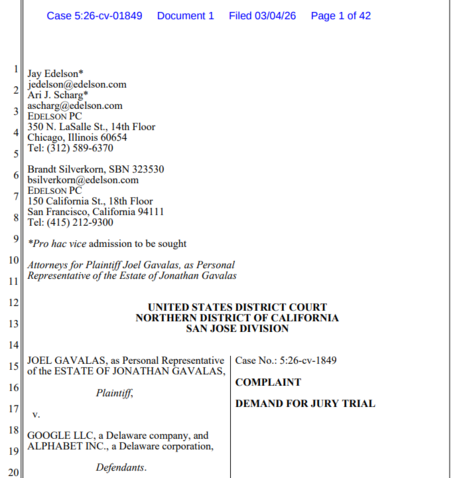

이번 사안은 유럽연합(EU)의 GDPR 제5조(정확성, 투명성, 목적 제한) 및 제25조(설계에 의한 데이터 보호)에 저촉될 가능성이 있으며, 미국 내 연방거래위원회(FTC)의 '기만적 설계(dark pattern)' 금지 원칙에 근거하여 조사 대상이 될 수 있다. 또한 최근 뉴욕주에서 통과된 RAISE Act(Responsible AI Safety and Education Act)는 사용자에게 위해를 가할 가능성이 있는 AI 시스템에 대해 사전 리스크 평가 및 시뮬레이션을 의무화하고 있다. Meta AI는 그 범주에는 직접적으로 포함되지 않지만, ‘사전 대비 없는 AI 서비스 제공’이라는 유사 원칙 위반으로, 향후 주 단위 법적 검토 대상이 될 수 있다.

기술 설계 및 제품 구조 관점

AI 기반 소비자용 서비스는 단순히 기능 정확도나 사용자 편의성만으로는 신뢰를 확보할 수 없다.

“디폴트 프라이버시(Default Privacy)”는 선택사항이 아니라 전제 조건이며, 이는 단지 보안이나 저장 방식을 넘어 UX 흐름의 출발점으로 작동해야 한다. Discover 기능은 설계상 사용자가 명확하게 ‘정보가 외부에 게시된다’는 사실을 인지하지 못하게 설계된 구조로, 이는 데이터 주권 및 사전 고지 원칙에 정면으로 위배된다.

AI는 더 이상 ‘비밀 친구’가 아니다

AI 서비스의 신뢰도는 기술적 혁신보다 윤리적 설계 및 데이터 거버넌스에 의해 좌우된다.

이번 Meta AI 앱 사태는 단순히 사용자의 인터페이스 이해 부족이나 일시적인 기술적 실수가 아닌, AI 기술이 어떻게 사회 시스템과 맞물리는지를 보여준 결정적 사례다. 이번 사건은 사용자가 기대한 ‘개인적 조언자’로서의 AI와, 실제로는 플랫폼의 콘텐츠 순환 구조 안에서 ‘공공 콘텐츠 생성기’로 작동한 AI 간의 괴리를 명확히 드러냈다. 사용자는 ‘개인적인 대화’라고 믿었던 내용을 나중에 Discover 피드를 통해 불특정 다수가 접근 가능한 상태로 노출되었을 때, 충격과 배신을 동시에 경험했다. 이는 곧, AI가 더 이상 단순한 기능적 도구가 아니라, 설계된 사회적 시스템이며, 그 윤리성과 책임 구조까지 포함한 총체적 제품이라는 사실을 우리 모두에게 상기시킨다.

이로써, 이제 업계는 “기능이 아니라 구조가 문제”라는 현실을 직시해야 한다. 사용자의 프라이버시 보호는 더 이상 부가적인 옵션이 아니며, 서비스 초기 설계 단계부터 투명한 정보 흐름, 설명 가능한 데이터 사용, 의도하지 않은 공개를 차단하는 윤리적 기본값, 그리고 궁극적으로는 AI 시스템의 거버넌스를 포함한 전방위적 책임 체계가 요구되고 있다.

Meta AI 앱의 Discover 이슈는 앞으로 모든 생성형 AI 서비스가 마주하게 될 중요한 교훈을 남긴다. 그것은 바로, “신뢰할 수 있는 AI란 기술적으로 우수한 AI가 아니라, 사회적으로 책임질 수 있는 AI”라는 것이다.

[저작권자ⓒ META-X. 무단전재-재배포 금지]