에이전트, 확산 모델, 하이브리드 설계 등 혁신적 방법론으로 전문 분야의 자동화 앞당겨

Agentic Reinforced Policy Optimization

https://arxiv.org/abs/2507.19849

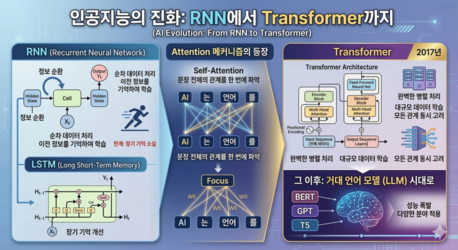

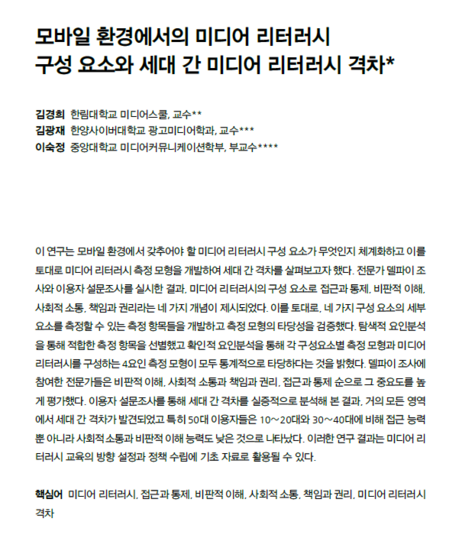

이 논문은 여러 차례에 걸쳐 외부 도구를 활용하는 대규모 언어 모델(LLM) 기반 에이전트의 성능을 최적화하기 위한 새로운 강화학습 알고리즘인 ARPO (Agentic Reinforced Policy Optimization)를 제안한다. 연구진은 LLM이 외부 도구를 사용한 직후에 생성하는 토큰의 불확실성(엔트로피)이 급격히 증가하는 현상을 발견했다. 이를 바탕으로 ARPO는 '엔트로피 기반 적응적 롤아웃' 메커니즘을 도입하여, 도구 사용 후 불확실성이 높은 시점에서 탐색을 강화한다. 또한, '어드밴티지 귀속 추정' 기법을 통해 모델이 단계별 도구 사용의 유불리를 학습하고 내재화하도록 한다. 실험 결과, ARPO는 계산 추론, 지식 추론, 심층 검색 등 13개의 벤치마크에서 기존 궤적 수준의 강화학습 알고리즘보다 뛰어난 성능을 보였으며, 기존 방법 대비 절반의 도구 사용 예산만으로 더 높은 성능을 달성하여 효율성과 확장성을 입증한다.

HunyuanWorld 1.0: Generating Immersive, Explorable, and Interactive 3D Worlds from Words or Pixels

https://arxiv.org/abs/2507.21809

이 논문은 텍스트나 이미지로부터 몰입형 3D 세계를 생성하는 새로운 프레임워크인 훈위안월드 1.0(HunyuanWorld 1.0)을 소개한다. 기존의 비디오 기반 생성 방식(다양하지만 3D 일관성 부족)과 3D 기반 생성 방식(일관성은 높지만 데이터 부족 및 비효율적)의 한계를 극복하기 위해 두 방식의 장점을 결합했다. 이 프레임워크의 핵심은 파노라마 이미지를 360도 세계의 대리인(proxy)으로 사용하는 의미론적으로 계층화된 3D 메시 표현 방식이다. 이를 통해 의미를 인식하며 세계를 분해하고 재구성하여 다양한 3D 세계를 생성할 수 있다. 그 결과, (1) 파노라마를 통한 360도 몰입 경험, (2) 기존 그래픽스 파이프라인과 호환되는 메시(mesh) 추출, (3) 상호작용성을 높이는 분리된 객체 표현이라는 세 가지 주요 장점을 가진다. 이 기술은 가상현실, 물리 시뮬레이션, 게임 개발 등 다양한 분야에 활용될 수 있다.

ScreenCoder: Advancing Visual-to-Code Generation for Front-End Automation via Modular Multimodal Agents

https://arxiv.org/abs/2507.22827

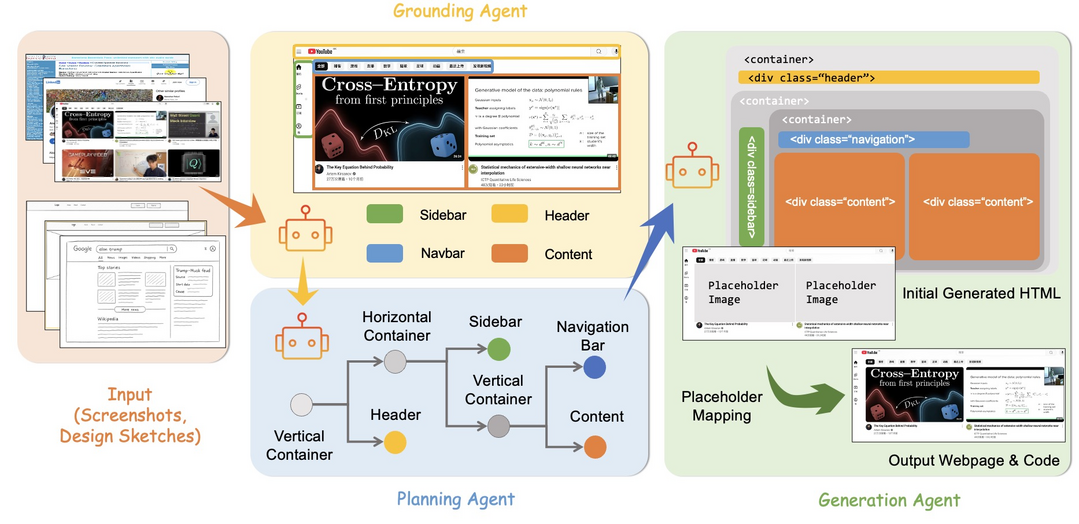

이 논문은 UI(사용자 인터페이스) 디자인 시안을 프론트엔드 코드로 자동 변환하는 기술을 발전시키기 위한 스크린코더(ScreenCoder)를 제안한다. 기존 방법들이 주로 텍스트 프롬프트에 의존해 시각적 디자인 의도를 제대로 파악하지 못하는 한계를 극복하기 위해, 스크린코더는 모듈형 다중 에이전트 프레임워크를 도입했다. 이 프레임워크는 (1) 그라운딩 에이전트가 시각-언어 모델을 이용해 UI 구성 요소를 탐지하고, (2) 계획 에이전트가 계층적 레이아웃을 구성하며, (3) 생성 에이전트가 적응형 프롬프트를 통해 HTML/CSS 코드를 생성하는 3단계로 작업을 수행한다. 이러한 모듈식 설계는 해석 가능성과 안정성을 높인다. 또한, 이 프레임워크를 확장하여 대규모 이미지-코드 쌍을 자동으로 생성하는 데이터 엔진을 구축했으며, 이를 통해 오픈소스 시각-언어 모델을 미세 조정하여 UI 이해도와 코드 품질을 크게 향상시킨다.

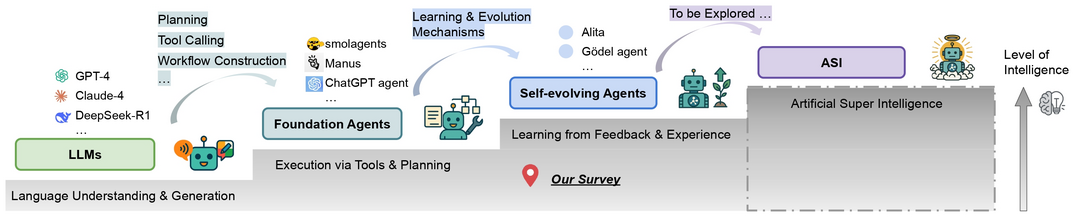

A Survey of Self-Evolving Agents: On Path to Artificial Super Intelligence

https://arxiv.org/abs/2507.21046

이 논문은 대규모 언어 모델(LLM)이 새로운 작업이나 지식에 스스로 적응하지 못하는 '정적인' 한계를 넘어, 실시간으로 추론하고, 행동하며, 진화할 수 있는 자기 진화 에이전트(Self-Evolving Agents)에 대한 최초의 체계적이고 포괄적인 서베이다. 연구는 자기 진화 에이전트를 이해하기 위한 세 가지 핵심 차원, 즉 무엇을(what) 진화시킬 것인가, 언제(when) 진화할 것인가, 어떻게(how) 진화할 것인가를 중심으로 구성된다. 각 차원에 따라 에이전트의 구성 요소(모델, 메모리, 도구 등)별 진화 메커니즘, 적응 단계(테스트 시간 내/간), 그리고 진화를 유도하는 알고리즘(보상, 피드백, 다중 에이전트 시스템 등)을 분석한다. 또한, 자기 진화 에이전트를 위한 평가 지표, 벤치마크, 응용 분야를 조명하고, 안전성, 확장성 등 미래 연구 방향을 제시하며 인공 초지능(ASI)으로 나아가는 로드맵을 제공한다.

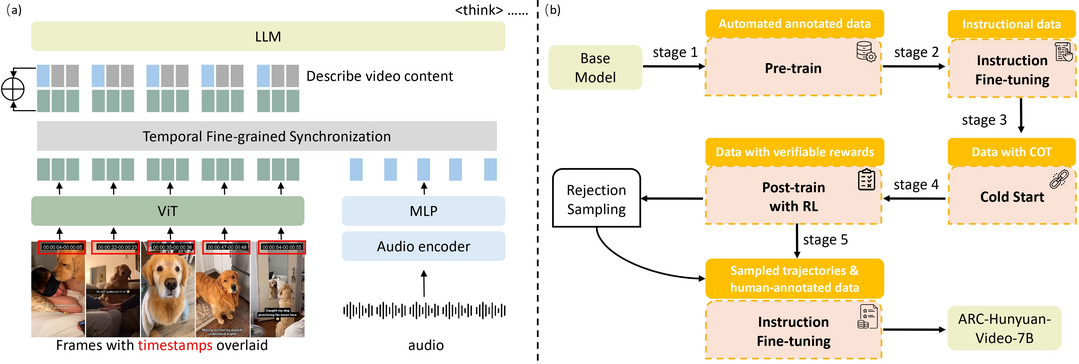

ARC-Hunyuan-Video-7B: Structured Video Comprehension of Real-World Shorts

https://arxiv.org/abs/2507.20939

이 논문은 위챗 채널이나 틱톡과 같은 플랫폼에서 소비되는 사용자 제작 짧은 동영상(Shorts)을 깊이 있게 이해하기 위한 멀티모달 모델인 ARC-훈위안-비디오(ARC-Hunyuan-Video)를 소개한다. 기존 모델들은 짧은 동영상의 복잡한 시각 요소, 높은 정보 밀도, 빠른 전개 속도를 제대로 처리하지 못했다. 이 모델은 비디오, 오디오, 텍스트 신호를 한 번에 처리하여, 타임스탬프가 찍힌 캡션 생성 및 요약, 개방형 질문 답변, 시간적 비디오 탐지 등 구조화된 비디오 이해 작업을 수행한다. 자동화된 주석 파이프라인으로 생성된 고품질 데이터로 사전 학습, 명령어 미세 조정, 강화학습 등 포괄적인 훈련을 거쳤다. 70억 개의 파라미터를 가진 비교적 작은 크기임에도 불구하고, 실제 서비스에 배포되어 사용자 참여도와 만족도를 실질적으로 향상시켰으며, 1분 길이의 비디오를 10초 만에 처리하는 높은 효율성을 보여준다.

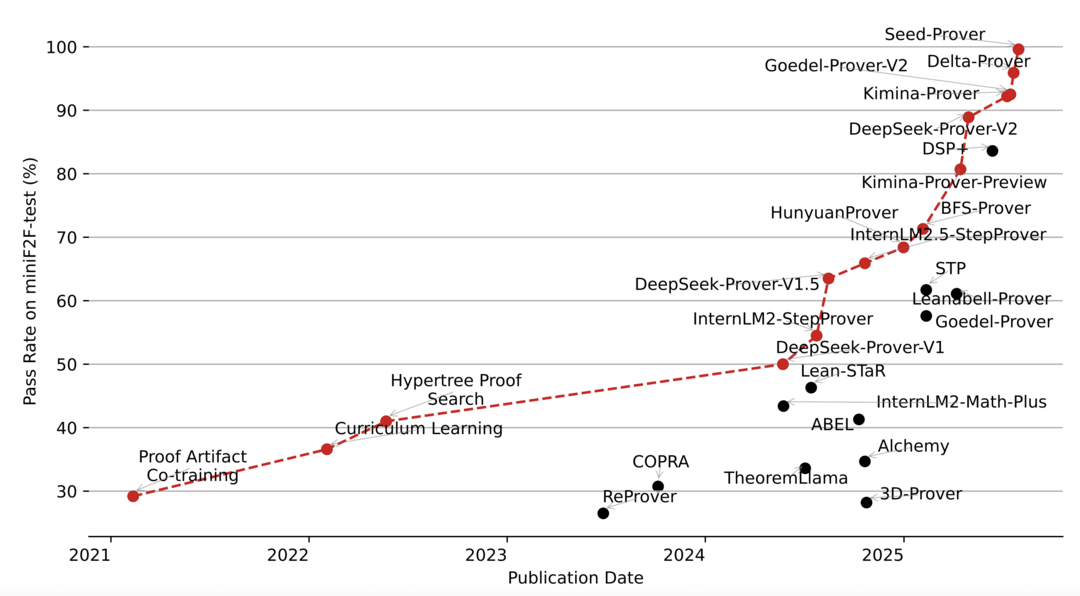

Seed-Prover: Deep and Broad Reasoning for Automated Theorem Proving

https://arxiv.org/abs/2507.23726

이 논문은 대규모 언어 모델(LLM)을 이용한 자동 정리 증명 시스템인 시드-프루버(Seed-Prover)를 제안한다. 기존 LLM은 자연어만으로는 명확한 감독 신호가 부족해 정리 증명에 어려움을 겪었지만, 이 모델은 Lean과 같은 형식 검증 언어를 활용하여 명확한 피드백을 받고 강화학습을 통해 효과적으로 훈련된다. 시드-프루버는 Lean의 피드백, 이미 증명된 보조정리(lemma), 그리고 자기 요약(self-summarization)을 통해 증명을 반복적으로 개선할 수 있다. 특히, 국제수학올림피아드(IMO) 수준의 문제를 풀기 위해 깊고(deep) 넓은(broad) 추론을 모두 가능하게 하는 세 가지 테스트 시간 추론 전략을 설계했다. 그 결과, 형식화된 과거 IMO 문제의 78.1%를 증명하고 주요 벤치마크에서 기존 최고 성능을 큰 차이로 뛰어넘었으며, 부족했던 기하학 추론을 위해 시드-지오메트리(Seed-Geometry) 엔진을 개발하여 IMO 2025에서 6문제 중 5문제를 완전히 증명하는 성과를 거두었다.

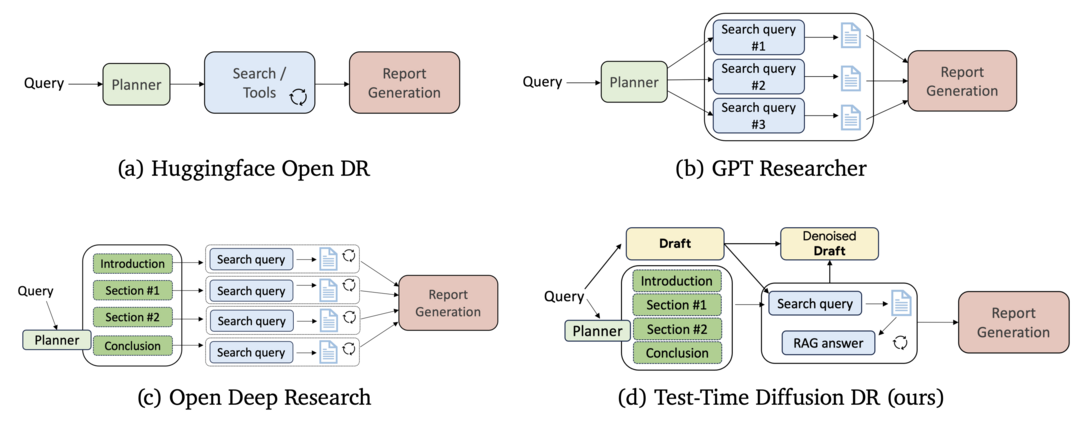

Deep Researcher with Test-Time Diffusion

https://arxiv.org/abs/2507.16075

이 논문은 복잡하고 긴 형식의 연구 보고서를 생성하는 딥 리서치 에이전트의 성능 한계를 극복하기 위한 새로운 프레임워크인 TTD-DR (Test-Time Diffusion Deep Researcher)을 제안한다. 인간의 연구 과정이 검색, 추론, 수정을 반복하는 것에서 영감을 받아, 보고서 생성 과정을 확산 과정(diffusion process)으로 개념화했다. TTD-DR은 연구 방향의 기반이 되는 초기 초안(skeleton)으로 시작하여, 각 단계에서 외부 정보를 통합하는 검색 메커니즘을 통해 초안을 반복적으로 정제("denoising")한다. 이 과정은 에이전트 워크플로우의 각 구성 요소에 적용된 자기 진화 알고리즘에 의해 더욱 향상된다. 이러한 초안 중심 설계는 보고서 작성 과정을 더 시의적절하고 일관성 있게 만들며, 반복적인 검색 과정에서 발생하는 정보 손실을 줄인다. TTD-DR은 심층적인 검색과 다단계 추론이 필요한 여러 벤치마크에서 기존 딥 리서치 에이전트를 크게 능가하는 최고 수준의 성능을 보인다.

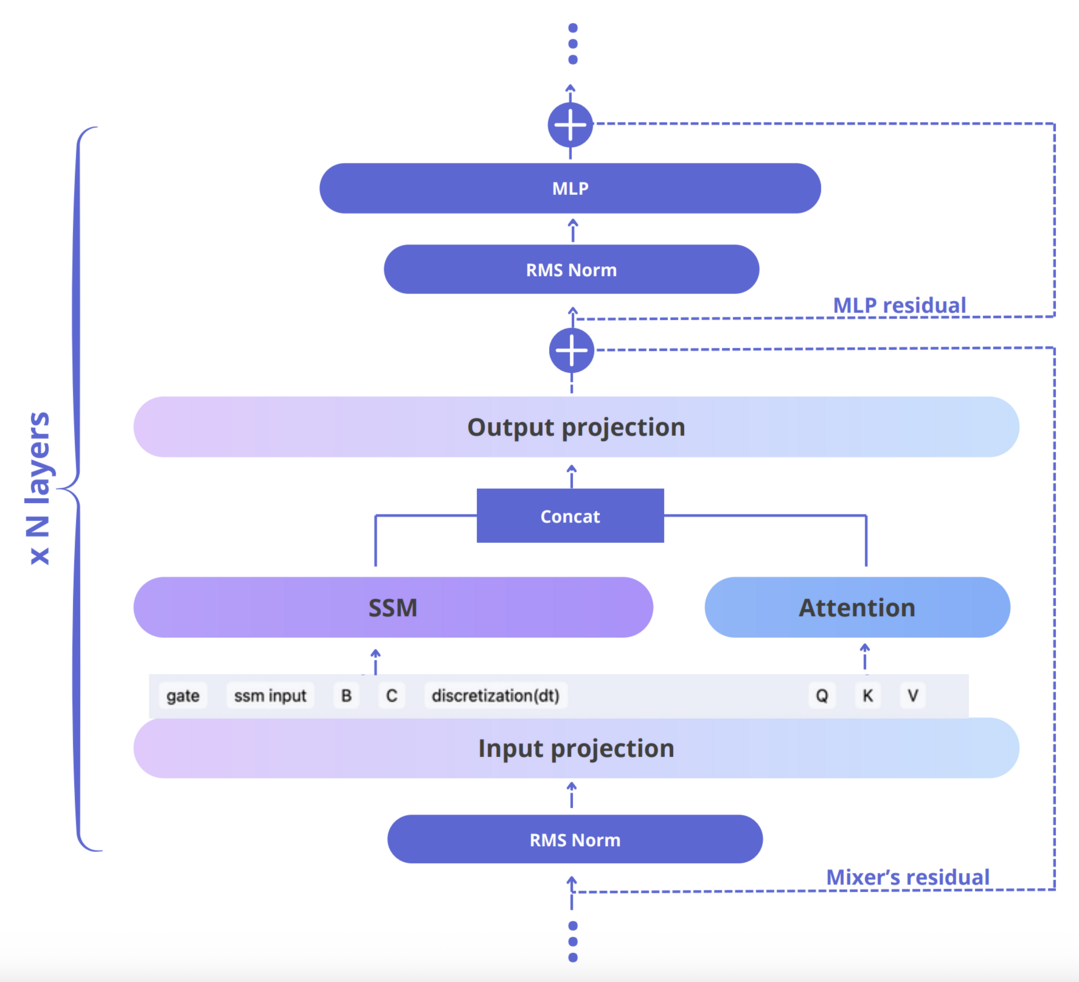

Falcon-H1: A Family of Hybrid-Head Language Models Redefining Efficiency and Performance

https://arxiv.org/abs/2507.22448

이 논문은 높은 성능과 효율성을 모두 최적화한 새로운 대규모 언어 모델(LLM) 시리즈인 팔콘-H1(Falcon-H1)을 소개한다. 기존 팔콘 모델과 달리, 팔콘-H1은 트랜스포머 기반의 어텐션과 긴 컨텍스트 처리 및 계산 효율성이 뛰어난 상태 공간 모델(SSM)을 결합한 병렬 하이브리드 아키텍처를 채택했다. 0.5B부터 34B 파라미터까지 다양한 크기의 모델로 출시되었으며, 벤치마크 테스트에서 뛰어난 파라미터 및 학습 효율성을 입증했다. 대표 모델인 팔콘-H1-34B는 Qwen3-32B, Llama3.3-70B와 같이 훨씬 더 큰 모델과 동등하거나 더 나은 성능을 보이면서도 더 적은 파라미터와 데이터를 사용했다. 작은 모델들 역시 비슷한 경향을 보여, 1.5B 모델이 현재 주력인 7B-10B 모델과 경쟁하고, 0.5B 모델이 2024년의 일반적인 7B 모델과 비슷한 성능을 낸다. 이 모델들은 최대 256K의 컨텍스트 길이와 18개 언어를 지원하며, 허용적인 오픈소스 라이선스로 공개되었다.

BANG: Dividing 3D Assets via Generative Exploded Dynamics

https://arxiv.org/abs/2507.21493

이 논문은 인간이 사물을 분해하고 재조립하는 직관적인 방식을 모방하여 3D 객체를 부품 단위로 유연하게 분해할 수 있는 새로운 생성형 접근법인 BANG을 제안한다. BANG의 핵심은 생성적 분해 동역학(Generative Exploded Dynamics)이라는 개념으로, 입력된 3D 모델에 대해 부품들이 점진적으로 분리되는 부드러운 '분해도' 시퀀스를 생성한다. 이 과정에서 각 부품의 기하학적, 의미적 일관성은 유지된다. BANG은 사전 훈련된 대규모 잠재 확산 모델(latent diffusion model)을 경량 어댑터를 사용해 미세 조정하여 분해 과정을 정밀하게 제어한다. 또한, 바운딩 박스나 표면 영역 같은 공간적 프롬프트를 통해 사용자가 어떤 부분을 어떻게 분해할지 지정할 수 있으며, GPT-4와 같은 멀티모달 모델과 연동하여 더욱 직관적인 작업도 가능하다. 이 기술은 부품별 상세 형상 생성, 기능 설명 연결, 3D 프린팅 시 조립이 용이하도록 부품을 분리 생성하는 등 다양한 응용 분야에 활용될 수 있다.

[METAX = 김한얼 기자]

[저작권자ⓒ META-X. 무단전재-재배포 금지]