[메타X(MetaX)] AI를 둘러싼 논쟁은 종종 윤리, 창작, 저작권의 언어로 시작한다. 그러나 산업의 실제 의사결정은 대체로 더 실무적인 질문에서 갈린다. 무엇을 허용할 것인가보다, 무엇을 공개할 것인가가 먼저 문제로 떠오른다.

게임 플랫폼의 역할은 단순히 유통 창구에 그치지 않는다. 플랫폼은 게임이 시장에 나오기 전부터 제출 서류, 빌드 검수, 신고 처리, 정책 집행 등 다양한 지점에서 이해관계를 가진다. 생성형 AI가 제작 과정에 들어오면, 플랫폼은 더 자주 “누가 무엇을 했는가”를 묻게 된다. 그리고 이 질문이 산업의 신뢰를 결정하는 경우가 늘고 있다.

결국 오늘의 논쟁은 AI가 유용한지, 위험한지의 문제가 아니라, AI를 둘러싼 정보(사용 여부와 범위)를 누가, 어떤 방식으로 관리할 것인가의 문제로 이동한다.

Steam의 선택: ‘판단’이 아니라 ‘기록’

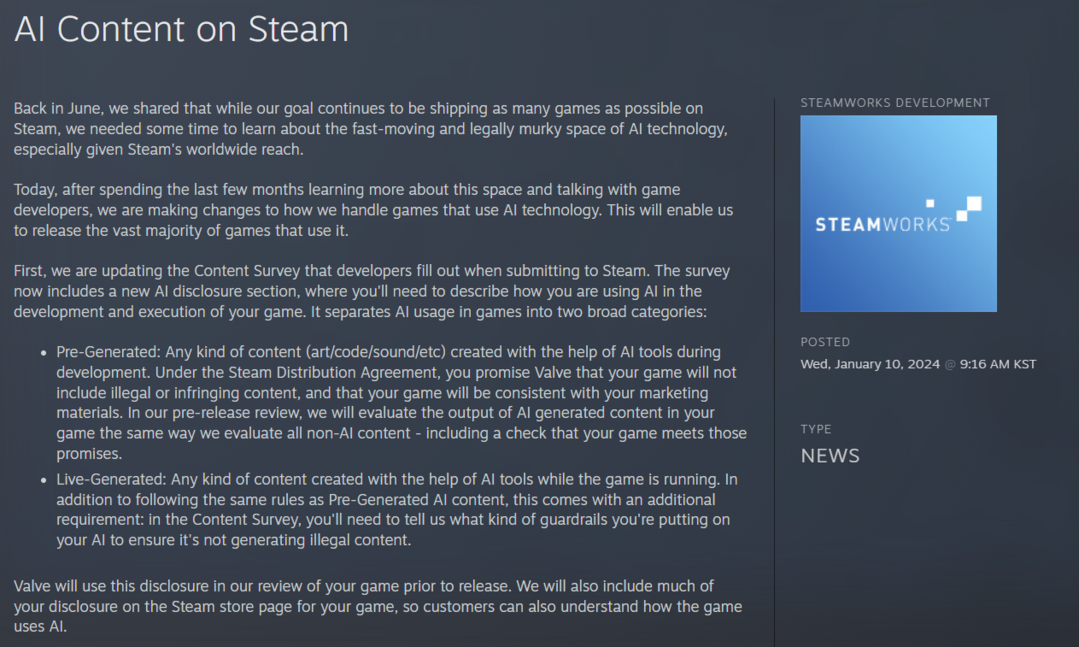

Valve가 운영하는 Steam은 2024년 1월 10일, 출시되는 게임을 대상으로, 생성형 AI 사용 여부를 공개하도록 요구하는 정책을 공식화했다. 이 정책에 따라 개발자는 Steamworks 등록 단계에서 AI 사용 여부를 밝히고, 사용했다면 그 적용 범위를 명시해야 한다. 공개 대상에는 아트, 텍스트, 음성, 코드 등 제작 전반이 포함된다.

Valve는 이 정책에서 생성형 AI 활용을 두 가지 범주로 구분한다. 첫째는 Pre-generated AI content로, 개발 과정에서 AI 도구를 활용해 미리 생성된 아트, 코드, 사운드 등을 의미한다. 둘째는 Live-generated AI content로, 게임이 실행되는 동안 AI가 실시간으로 콘텐츠를 생성하는 경우다.

특히 Live-generated AI 콘텐츠의 경우, Valve는 보다 명확한 조건을 부과한다. 개발자는 불법 콘텐츠나 정책 위반 결과물이 생성되지 않도록 가드레일(guardrails)이 구현돼 있음을 증명해야 하며, 이 정보는 Steam 페이지를 통해 소비자에게 공개된다. 즉, Steam은 AI 사용 사실뿐 아니라 AI가 언제, 어떤 방식으로 작동하는지를 구분해 기록하도록 요구한다.

중요한 점은, Steam이 이 정책을 통해 AI 사용을 금지하거나 평가하지 않는다는 점이다. Valve는 품질이나 윤리 기준을 설정하지도 않는다. Valve의 공식 설명은 비교적 분명하다. “우리는 AI 기술을 사용한 게임을 가능한 한 많이 출시하는 것이 목표다. 다만 법적으로 불확실한 영역이었기 때문에, 정책을 정리하는 데 시간이 필요했다.”

이 발언이 시사하는 바는 명확하다. Steam의 정책은 통제나 규제가 아니라, 플랫폼 차원의 사전 기록 체계에 가깝다. 핵심은 “AI를 썼는가”에 대한 판단이 아니라, “무엇이, 언제, 어떤 방식으로 기록돼 있는가”다. 문제가 발생했을 때 플랫폼이 확인할 수 있는 기준점을 미리 마련해 둔 셈이다.

이 정책이 실제 시장에서 곧바로 부정적 효과를 낳았다고 보기는 어렵다. 업계 집계에 따르면, 2025년 말 기준으로 AI 사용 사실을 공개한 Steam 게임들의 누적 매출은 수억 달러 규모에 이르며, 다수의 타이틀이 의미 있는 상업적 성과를 거둔 것으로 알려져 있다. 일부 대형 프랜차이즈와 라이브 서비스 게임 역시 AI 활용 사실을 명시한 상태로 유통되고 있다.

이는 적어도 한 가지 점을 보여준다. AI 사용 공개가 곧 판매량 하락이나 시장 배제로 직결되지는 않는다는 것이다. 오히려 Steam의 접근은, AI 활용 여부를 숨길 것인가의 문제가 아니라 어떻게 설명하고 기록할 것인가의 문제로 논쟁의 초점을 이동시킨다.

결국 Steam이 선택한 길은 명확하다. 판단은 하지 않되, 기록은 남긴다. 그리고 그 기록은 향후 분쟁, 신뢰 논란, 정책 판단의 출발점이 된다. 이는 생성형 AI가 일상적인 제작 도구가 된 이후, 플랫폼이 감당해야 할 책임의 범위를 어디까지 설정할 것인가에 대한 Valve의 답변에 가깝다.

Tim Sweeney의 반론: “태그는 의미 없다”

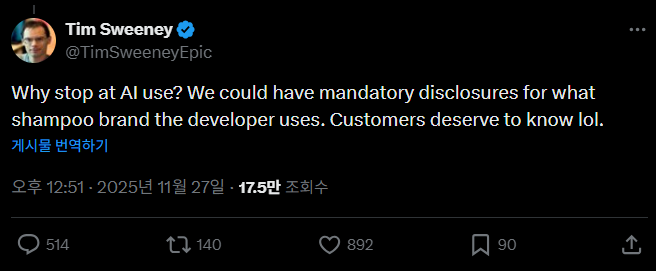

2025년 11월 26일, Sweeney는 X(구 트위터)를 통해 Steam의 생성형 AI 공개 정책을 정면으로 비판했다. 그는 AI 사용 여부를 스토어 차원에서 별도로 표시하는 접근 자체가 게임 유통 환경과는 맞지 않는다는 입장을 분명히 했다.

Tim Sweeney는 Epic Games의 CEO다. Fortnite와 Unreal Engine을 보유한 회사의 수장이자, 동시에 Epic Games Store를 통해 Steam과 직접 경쟁하는 플랫폼 운영자이기도 하다. 그의 발언은 단순한 개인 의견이 아니라, 경쟁 플랫폼의 철학을 드러내는 메시지로 읽힌다.

Sweeney의 주장은 비교적 단순하지만, 그 전제는 명확하다. 그는 AI 태그가 모든 맥락에서 무의미하다고 보지는 않는다. 예컨대 미술 전시회에서 저작권 표기가 필요하거나, 디지털 콘텐츠 라이선스 마켓에서 권리 관계를 이해해야 할 경우에는 AI 사용 여부가 정보로서 의미를 가질 수 있다고 인정한다.

그러나 게임 스토어는 다르다는 것이 그의 주장이다. Sweeney는 “AI는 곧 거의 모든 제작 과정에 관여하게 될 것”이라며, 그런 상황에서 “AI를 썼는지 여부”를 기준으로 콘텐츠를 구분하는 것은 현실을 반영하지 못하는 분류가 될 수 있다고 지적했다.

그는 이 논지를 풍자적으로 확장했다.

“AI 사용까지 표기해야 한다면, 개발자가 어떤 샴푸를 쓰는지도 공개해야 하는 것 아닌가. 고객들은 알 권리가 있으니까.”

농담 섞인 표현이지만, 의도는 분명하다. 제작 과정의 모든 도구와 선택을 공개 대상으로 삼기 시작하면, 표기는 정보가 아니라 과잉 노출이자 형식적 절차로 전락할 수 있다는 것이다.

Sweeney의 논리를 한 문장으로 요약하면 이렇다.

생성형 AI가 보편적 제작 도구가 되는 순간, ‘AI를 썼는지’라는 질문은 의미를 잃고, 오히려 낙인이 될 위험이 커진다. 따라서 스토어에서 중요한 것은 제작 도구의 목록이 아니라, 최종 결과물의 품질과 완성도여야 한다는 주장이다.

이 관점은 Epic Games Store의 실제 정책과도 일치한다. Epic Games Store는 현재 Steam과 달리 AI 사용 여부를 공개하도록 요구하는 정책을 운영하지 않는다. Epic의 플랫폼 철학은, 제작 과정에 대한 표기보다 시장과 이용자의 판단에 최대한 맡기는 방식에 가깝다.

결국 Sweeney의 발언은 단순한 ‘AI 태그 반대’가 아니다. 이는 게임 스토어가 어디까지 개입할 수 있는지, 그리고 플랫폼이 중개자에 머물 것인지, 제작 과정의 관리자로 확장될 것인지에 대한 근본적인 질문이다. Steam이 ‘기록’을 선택했다면, Sweeney는 그 기록 자체가 불필요해질 미래를 전제하며 반론을 제기하고 있는 셈이다.

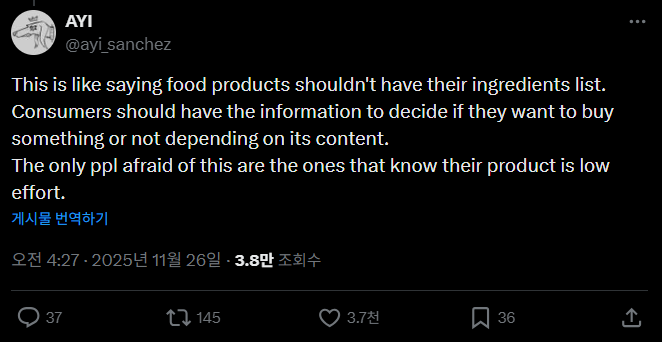

Valve 측의 즉각적 반응: “성분표와 같다” Tim Sweeney의 비판 직후 Valve 내부 인사가 공개적으로 반론을 제기했다는 점은 주목할 만하다.

Counter-Strike 시리즈에 참여한 Valve 소속 아티스트 Ayi Sánchez는 X를 통해,

Steam의 AI 공개 정책을 소비자 정보 제공의 문제로 규정했다.

그는 “이건 식품에 성분표를 붙이지 말라는 것과 같다”며, 소비자는 구매 여부를 결정하기 위해 필요한 정보를 알 권리가 있다고 주장했다.

이 발언은 Valve가 취한 ‘AI 사용 공개’ 정책을 도덕적 판단이나 기술 규제가 아니라, 정보 비대칭을 줄이기 위한 최소한의 투명성 장치로 해석하는 시각을 분명히 보여준다.

즉, AI 표기는 평가가 아니라 고지(disclosure)라는 논리다.

이 반응을 계기로, 논쟁의 초점은 “AI를 쓰느냐 마느냐”에서 플랫폼이 정보를 어디까지 공개해야 하는가로 이동한다.

논쟁의 본질: 기술이 아닌 플랫폼 철학

Steam과 Tim Sweeney의 입장 차이는, 플랫폼이 어떤 역할을 수행해야 하는가에 대한 철학적 차이에서 비롯된다.

Steam이 취한 입장은 비교적 명확하다. 플랫폼은 단순한 유통 창구가 아니라, 향후 발생할 수 있는 분쟁과 신뢰 문제에 대비해 정보를 보존·관리하는 주체여야 한다는 인식이다. 이 관점에서 AI 사용 공개는 규제가 아니라, “문제가 발생했을 때 무엇이 기록돼 있는가”를 확인하기 위한 관리 장치다.

때문에 Steam은 판단을 유보한 채, 기록을 남긴다.

반면 Tim Sweeney가 대표하는 Epic의 시각은 다르다. 플랫폼은 어디까지나 중개자에 머물러야 하며, 제작 과정에 대한 세부 표기는 최소화해야 한다는 입장이다. AI가 보편적 도구가 되는 상황에서

특정 제작 기술을 별도로 표시하는 행위는 정보 제공이 아니라 불필요한 구분이 될 수 있다는 판단이다. 결과물의 가치는 시장과 이용자가 판단해야 한다는 논리다.

이처럼 양측의 충돌은 AI 기술의 위험성이나 가능성에 대한 의견 차이가 아니라, 플랫폼이 신뢰를 ‘관리’할 것인가, 아니면 판단을 ‘위임’할 것인가라는 선택의 문제다.

Steam은 투명성을 통해 미래의 책임을 관리하려 하고, Epic은 개입을 최소화해 시장 자율에 맡기려 한다. AI 공개 정책을 둘러싼 논쟁은, 결국 이 두 플랫폼 철학이 정면으로 부딪힌 결과다.

‘지금’ 이 논쟁의 의미

이 논쟁이 지금 중요해지는 이유는 AI 기술이 새로워졌기 때문이 아니다. 생성형 AI는 이미 게임 제작 현장에 깊숙이 들어와 있으며, 확산 속도 역시 예측의 영역을 벗어났다. 지금의 변화는 기술의 문제가 아니라, AI 사용이 실제 분쟁과 책임 문제로 연결되기 시작했다는 점에 있다.

우선 AI는 더 이상 실험적 도구가 아니다. 상용 제작 환경에서 활용되면서, AI 사용 여부는 단순한 제작 선택을 넘어 신뢰와 공정성, 책임 소재를 가르는 기준으로 작동하기 시작했다. 제작 과정의 일부가 공개되지 않았을 때, 그 공백은 곧 논란의 출발점이 된다.

동시에 플랫폼은 이미 기준을 만들고 있다. Steam의 AI 공개 정책은 큰 선언이나 충격 없이 운영되고 있지만, 철회되거나 완화되지 않은 채 유지되고 있다는 점이 중요하다. 이런 정책은 보통 단발성 규제가 아니라, 시간을 두고 업계 관행을 재편하는 전제 조건으로 기능한다. 조용히 도입된 기준이 결국 ‘당연한 절차’가 되는 순간, 논쟁의 성격은 바뀐다.

무엇보다 지금은 기준이 굳어지기 직전의 시점이다. AI 사용에 대한 표기와 고지가 선택 사항으로 남아 있는 동안에는 논쟁이 가능하지만, 이것이 기본 요건으로 자리 잡는 순간, 질문은 “옳은가”가 아니라 “지켰는가”로 바뀐다. 이후에는 기술적 가능성이나 윤리적 평가보다, 정책 준수와 신뢰 관리가 산업의 일상 업무가 된다.

그래서 이 논쟁은 미래를 상상하는 토론이 아니다. 이는 생성형 AI 이후의 게임 산업에서 어떤 기준이 표준으로 굳어질 것인지를 가르는, 현재 진행형의 선택에 가깝다.

AI 이후, 플랫폼의 역할이 갈린다

Steam과 Tim Sweeney의 충돌은 특정 기술이나 개인 발언을 둘러싼 논쟁이 아니다. 이는 생성형 AI가 일상적인 제작 도구가 된 이후, 게임 플랫폼이 어떤 책임을 떠안을 것인가에 대한 선택을 드러낸 사건이다.

어느 쪽이 옳다고 단정하기는 이르다. 그러나 한 가지는 분명하다. AI는 사라지지 않으며, 이 논쟁 역시 일회성으로 끝나지 않는다. 표기와 고지를 둘러싼 기준은 머지않아 관행이 되고, 규칙이 되고, 책임의 출발점이 될 가능성이 크다.

앞으로 게임 산업이 반복해서 마주하게 될 질문은 단순해질 것이다. “AI를 썼는가?”가 아니라, “AI 사용을 어떻게 설명했는가?” 이다.

그리고 그 질문에 대한 답을 누가 어떻게 설계하느냐에 따라, 플랫폼은 중개자로 남을 수도, 신뢰의 관리자라는 역할을 떠안을 수도 있다.

결국, AI 이후의 게임 산업에서의 진짜 경쟁은, 기술이 아니다. 책임의 경계를 누가 먼저, 그리고 어떻게 긋느냐에 달려 있다.

[METAX = 김하영 기자]

[저작권자ⓒ META-X. 무단전재-재배포 금지]